[ad_1]

OpenAI CEO’su Sam Altman, yakın zamanda Birleşik Arap Emirlikleri’ne yaptığı bir gezi sırasında endişeyi dile getirdi AI’nın insanlık için oluşturabileceği “varoluşsal risk” hakkında. Yapay zekayı düzenlemek ve bu riskleri yönetmek için Altman, IAEA gibi küresel bir yapının oluşturulmasını önerdi.

Altman, yapay zekayı düzenlemek için benzer bir stratejiye olan ihtiyacı IAEA’nın nükleer enerji düzenlemesine benzetti. Yapay zekanın getirdiği faydalar ile neden olduğu sorunları dengelemeye ihtiyaç olduğunu söyledi.

OpenAI Karıştırmaya Neden Oldu

AI uygulamalarına atıfta bulunan belirli endişeleri olan kişi o değil. Hatırlayacağınız gibi İtalya, gizlilik ve veri koruma endişeleri nedeniyle OpenAI’nin ChatGPT’sine erişimi engelledi. İtalyan veri koruma gözlemcisine göre Avrupa Birliği’nin Genel Veri Koruma Yönetmeliği (GDPR), yasağı haklı çıkaran OpenAI tarafından ihlal edildi. Gözlemcinin, ChatGPT’nin yanıtları hakkında endişeleri vardı.

Yerel Veri Koruma Kurumu, OpenAI’ye bu gizlilik endişelerini ele alacak bir strateji bulması için 20 gün süre verdi. Buna uyulmaması, OpenAI’nin yıllık net kârının %4’ü olan 21,8 milyon dolarlık ağır bir para cezasına neden olabilir. Ancak OpenAI bunu düzeltmeyi başardı.

Haftanın Gizchina Haberleri

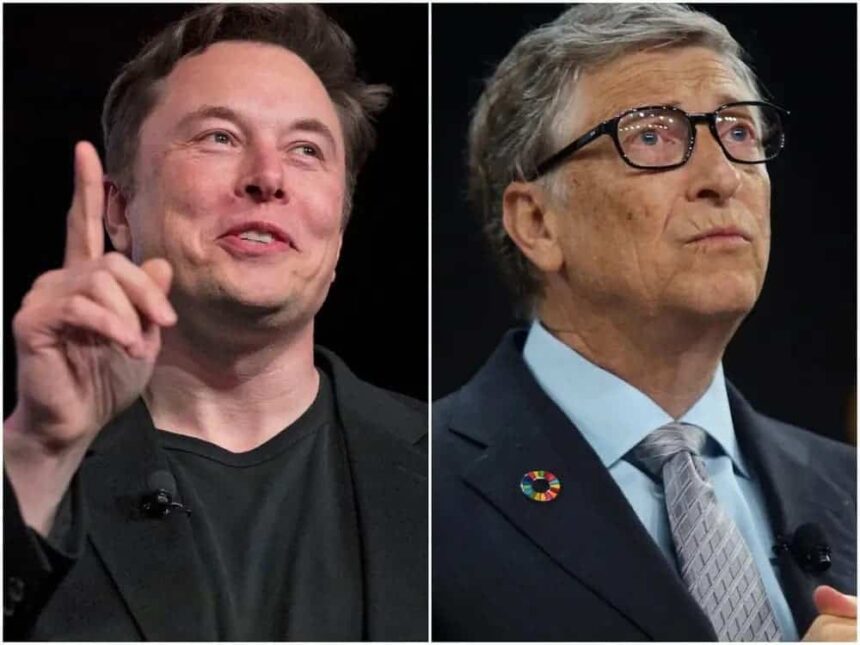

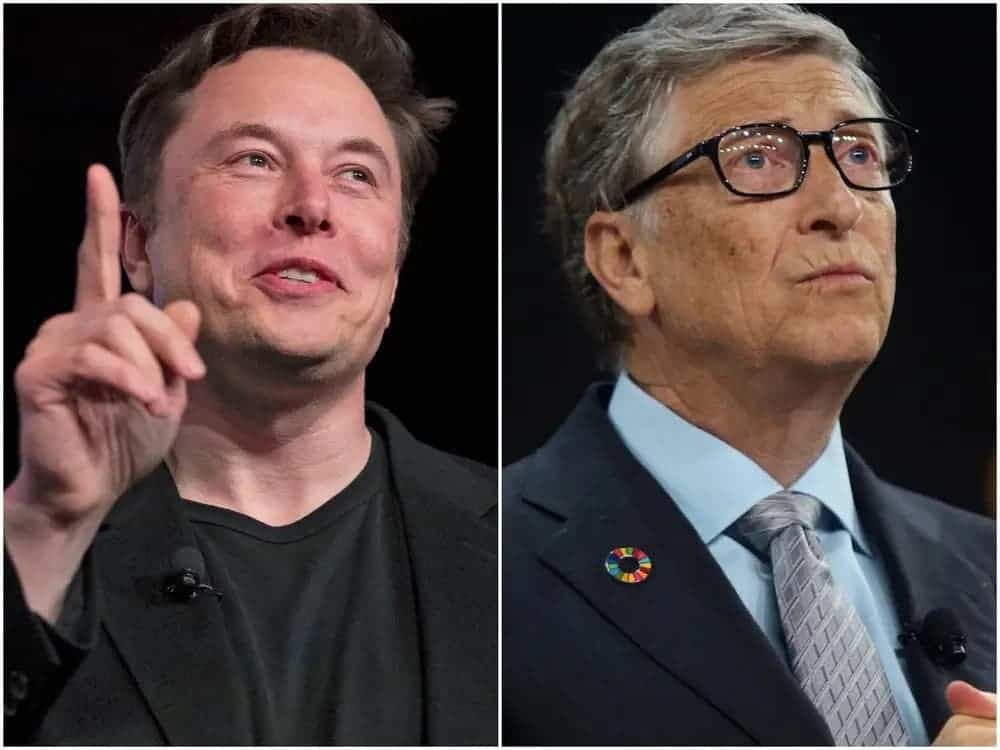

Kuralların yanı sıra, AI topluluğu içinde devam eden kavgalar var. İçinde cıvıldamakOpenAI’nin kurucu ortaklarından Elon Musk, Bill Gates’in yapay zeka hakkındaki düşünceleriyle alay etti. Musk, ilk görüşmelerini anlattı ve Gates’in yapay zeka hakkındaki düşüncelerinin sınırlı olduğunu ima etti. Bu konuşma, Gates’in OpenAI’ye katılması ve yapay zekanın iş, sağlık ve eğitim gibi sektörleri nasıl değiştirebileceğine dair olumlu düşünceleri hakkındadır.

Gates dışında Musk, 2018’de yönetim kurulundan ayrıldığından beri şirketin yönünü eleştiriyor. Pek çok kullanıcının OpenAI ve Microsoft’un aynı gemide olduğunu düşünmesinden hoşlanmadı. Bu sözler, Musk ile Gates arasında, 2020’de COVID-19 salgınının ciddiyeti ve diğer konularda anlaşmazlığa düştüklerinde başlayan, devam eden rekabeti gösteriyor.

[ad_2]